Ένας 60χρονος άνδρας κατέληξε στο νοσοκομείο αφού ρώτησε το ChatGPT πώς να αφαιρέσει το χλωριούχο νάτριο από τη διατροφή του.

Καθώς οι άνθρωποι αλληλεπιδρούν όλο και περισσότερο με την τεχνητή νοημοσύνη, συνεχίζουν να κυκλοφορούν ιστορίες για το πόσο επικίνδυνη, μερικές φορές ακόμη και θανατηφόρα, μπορεί να είναι μια συνομιλία με ένα chatbot.

Ενώ μέρος της προσοχής έχει επικεντρωθεί στην ψυχική υγεία και στις ανησυχίες ότι τα chatbots δεν είναι εφοδιασμένα για να αντιμετωπίσουν αυτού του είδους τα προβλήματα, υπάρχουν επίσης επιπτώσεις για τη σωματική υγεία των ανθρώπων.

Συχνά ακούμε ότι δεν πρέπει να αναζητούμε τα συμπτώματά μας στο Google, καθώς οι ιατρικές συμβουλές πρέπει να δίνονται από επαγγελματίες υγείας, οι οποίοι γνωρίζουν το ιατρικό μας ιστορικό και μπορούν να μας εξετάσουν.

Σύμφωνα με ένα νέο περιστατικό που δημοσιεύθηκε την Τρίτη στο American College of Physicians Journals, πρέπει επίσης να είμαστε προσεκτικοί όταν σκοπεύουμε να κάνουμε ερωτήσεις σχετικά με την υγεία σε ένα chatbot.

Η δημοσίευση εξέτασε την περίπτωση ενός άνδρα που ανέπτυξε βρωμισμό μετά από συμβουλή του ChatGPT σχετικά με τη διατροφή του.

Ο βρωμισμός, ή τοξικότητα εξαίτιας συσσώρευσης βρωμίου, ήταν γνωστός στις αρχές της δεκαετίας του 1990, αλλά είναι λιγότερο συχνός σήμερα. Τότε, τα άλατα βρωμίου εντοπίζονταν σε πολλά φάρμακα χωρίς συνταγογράφηση για τη θεραπεία της αϋπνίας, της υστερίας και του άγχους. Η υπερβολική πρόσληψη βρωμίου μπορεί να προκαλέσει νευροψυχιατρικά και δερματολογικά συμπτώματα.

Ο άνδρας σε αυτή την περίπτωση δεν είχε ψυχιατρικό ή ιατρικό ιστορικό, αλλά κατά τις πρώτες 24 ώρες της νοσηλείας του, παρουσίασε αυξημένη παράνοια και ακουστικές και οπτικές ψευδαισθήσεις.

«Παρατηρήθηκε ότι ήταν πολύ διψασμένος, αλλά παρανοϊκός σχετικά με το νερό που του προσφέρθηκε», αναφέρεται στη σχετική δημοσίευση.

Ο άνδρας έλαβε θεραπεία με υγρά και ηλεκτρολύτες και η κατάστασή του σταθεροποιήθηκε, επιτρέποντας την εισαγωγή του στην ψυχιατρική κλινική του νοσοκομείου.

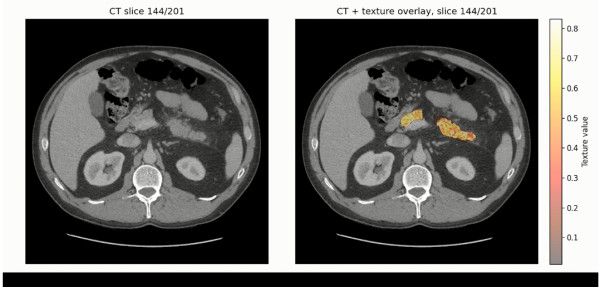

Καθώς η κατάστασή του βελτιώθηκε, μπόρεσε να αναφέρει ορισμένα συμπτώματα που είχε παρατηρήσει, όπως ακμή στο πρόσωπο και κερασοειδή αιμαγγιώματα, τα οποία ενίσχυαν την υποψία ότι έπασχε από βρωμισμό.

Είπε επίσης ότι είχε αντικαταστήσει το χλωριούχο νάτριο, ή αλάτι, με βρωμιούχο νάτριο για τρεις μήνες, αφού είχε διαβάσει για τις αρνητικές επιπτώσεις του αλατιού στην υγεία.

«Εμπνευσμένος από τις σπουδές του στη διατροφή στο πανεπιστήμιο, αποφάσισε να πραγματοποιήσει ένα προσωπικό πείραμα για να εξαλείψει το χλωριούχο άλας από τη διατροφή του», αναφέρεται στη μελέτη του περιστατικού.

Είχε αντικαταστήσει το επιτραπέζιο αλάτι με «βρωμιούχο νάτριο που αγόρασε από το διαδίκτυο μετά από συμβουλή του ChatGPT, όπου είχε διαβάσει ότι το χλωριούχο άλας μπορεί να αντικατασταθεί με βρωμιούχο, αν και πιθανότατα για άλλους σκοπούς, όπως τον καθαρισμό».

Ο άνδρας πέρασε τρεις εβδομάδες στο νοσοκομείο πριν να αναρρώσει αρκετά ώστε να πάρει εξιτήριο.

«Είναι σημαντικό να ληφθεί υπόψη ότι το ChatGPT και άλλα συστήματα τεχνητής νοημοσύνης μπορούν να παράγουν επιστημονικές ανακρίβειες, δεν έχουν την ικανότητα να εξετάζουν κριτικά τα αποτελέσματα και, τελικά, να τροφοδοτούν τη διάδοση παραπληροφόρησης», προειδοποίησαν οι συγγραφείς της έκθεσης.

Η Open AI, η εταιρεία που ανέπτυξε το ChatGPT, παραδέχεται στους Όρους Χρήσης της ότι τα αποτελέσματα του chatbot «ενδέχεται να μην είναι πάντα ακριβή».

«Δεν πρέπει να βασίζεστε στα αποτελέσματα των Υπηρεσιών μας ως μοναδική πηγή αλήθειας ή πραγματικών πληροφοριών, ή ως υποκατάστατο επαγγελματικών συμβουλών», αναφέρουν οι Όροι Χρήσης.

Οι Όροι Παροχής Υπηρεσιών της εταιρείας αναφέρουν επίσης ρητά: «Οι Υπηρεσίες μας δεν προορίζονται για χρήση στη διάγνωση ή τη θεραπεία οποιασδήποτε πάθησης».